Јувал Ноа ХАРАРИ*

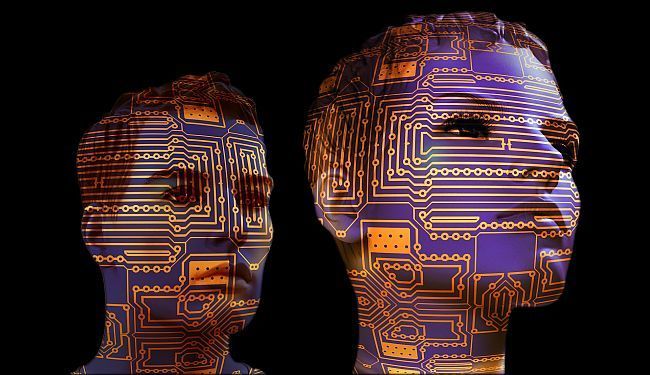

Што би се случило ако нечовечката интелигенција стане подобра од просечниот човек во раскажување приказни, компонирање мелодии, цртање слики и пишување закони и стихови? Кога луѓето мислат на ChatGPT и други нови алатки за вештачка интелигенција, тие често мислат на примери како што се учениците кои користат вештачка интелигенција за да ја напишат својата домашна задача. Што ќе се случи со училишниот систем кога децата ќе почнат да го прават тоа? Овој тип на прашања ја пропушта пошироката слика.

Заборавете на училишните домашни задачи. Размислете за следната претседателска трка во САД во 2024 година и обидете се да го замислите влијанието на алатките за вештачка интелигенција што можат масовно да произведуваат политичка содржина, лажни вести и списи за некои нови култови.

Во последните години, култот qAnon се собра околу анонимни онлајн пораки, познати како „q drops“. Следбениците ги собираа, обожаваа и ги толкуваа овие „капки“ како свет текст. Додека според нашите сознанија, сите досегашни „капки“ биле составени од луѓе, а ботовите само помагале во нивното ширење, во иднина би можеле да ги видиме првите култови во историјата чии „свети“ текстови ги пишувала нечовечката интелигенција. Религиите низ историјата тврделе дека нивните свети книги не се од човечко потекло. Тоа наскоро би можело да стане реалност.

На попрозаично ниво, наскоро би можеле да се вклучиме во долги онлајн дискусии за абортусот, климатските промени или руската инвазија на Украина со ентитети за кои мислиме дека се луѓе – но всушност се вештачка интелигенција. Уловот е што е сосема бесмислено да се троши време обидувајќи се да ги промени декларираните мислења на бот со вештачка интелигенција, кога бот со вештачка интелигенција може да ги усоврши своите пораки толку прецизно што ќе има добри шанси да влијае на нас.

Религиите низ историјата тврделе дека нивните свети книги не се од човечко потекло. Тоа наскоро би можело да стане реалност.

Преку своето владеење на јазикот, вештачката интелигенција може дури и да формира интимни односи со луѓето и да ја искористи моќта на интимноста за да го промени нашето размислување и нашите погледи на светот. Иако нема индикации дека вештачката интелигенција има сопствена свест или чувства, за да поттикне лажна интимност со луѓето, доволно е вештачката интелигенција да ги натера луѓето да се чувствуваат емотивно поврзани со неа.

Во јуни 2022 година, Блејк Лемоин, инженер на Гугл, јавно тврдеше дека четботот со вештачка интелигенција Ламбда, на кој тој работел, станал чувствителен. Контроверзното тврдење го чинеше губење на работното место. Но, најинтересното нешто во оваа епизода не беше тврдењето на г-дин Лемоин, кое веројатно беше лажно, туку неговата подготвеност да ја ризикува својата профитабилна работа во корист на чет-бот со вештачка интелигенција. Ако вештачката интелигенција може да влијае на луѓето да ги ризикуваат своите работни места поради тоа, што друго би можела да ги инспирира да прават?

ВИ има способност да воспостави „интимна“ блискост со луѓето

Во политичката битка за умови и срца, интимноста е најефективното оружје, а вештачката интелигенција штотуку се здоби со способност за масовно производство на интимни односи со милиони луѓе.

Сите знаеме дека во изминатата деценија социјалните мрежи станаа бојно поле за контрола на човечкото внимание. Со новата генерација на вештачка интелигенција, бојното поле се префрла од внимание кон интимност.

Што ќе се случи со човечкото општество и човечката психологија додека вештачката интелигенција се бори со вештачката интелигенција во битка за лажни интимни односи со нас, односи кои потоа може да се искористат за да не убедат да гласаме за одредени политичари или да купуваме одредени производи?

Дури и без создавање „лажна интимност“, новите алатки за вештачка интелигенција би имале огромно влијание врз нашите мислења и погледи на светот. Луѓето можат да почнат да користат еден советник за вештачка интелигенција како „пророк“ кој знае сѐ. Не е ни чудо што Гугл е преплашен. Зошто да се мачам да барам кога можам само да го прашам „пророкот“?

Иако нема индикации дека вештачката интелигенција има сопствена свест или чувства, за да поттикне лажна интимност со луѓето, доволно е вештачката интелигенција да ги натера луѓето да се чувствуваат емотивно поврзани со неа.

Индустриите за вести и реклами исто така треба да бидат преплашени. Зошто да го читам весникот кога можам само да побарам од „пророкот“ да ми ги каже најновите вести? И што е поентата на рекламирањето, кога можам само да го прашам пророкот да ми каже што да купам?

Па дури и овие сценарија навистина не ја покажуваат поголемата слика. Она за што зборуваме е потенцијалниот крај на човечката историја. Не крајот на историјата, туку крајот на нејзиниот дел во кој доминира човек.

Историјата е интеракција помеѓу биологијата и културата; помеѓу нашите биолошки потреби и желби за работи како храна и секс, и нашите креации како религиите и законите. Историјата е процес низ кој законите и религиите ја обликуваат храната и сексот.

Што ќе се случи со текот на историјата кога вештачката интелигенција ќе ја преземе културата и ќе почне да произведува приказни, мелодии, закони и религии?

Претходните алатки како печатницата и радиото помогнаа да се шират културните идеи на луѓето, но тие никогаш не создадоа нови сопствени културни идеи.

ВИ е фундаментално различна. ВИ може да создаде сосема нови идеи, сосема нова култура.

Најпрво, вештачката интелигенција веројатно ќе ги имитира човечките прототипи на кои се „градела“ во своето „детство“. Но, со секоја измината година, културата на вештачката интелигенција смело ќе гази онаму каде што никој досега не отишол. Со милениуми, човечките суштества живееле во соништата на другите луѓе. Во наредните децении, можеби ќе се најдеме како живееме во соништата за нечовечка интелигенција.

Темната страна на ВИ

Стравот од вештачката интелигенција го прогонува човештвото само во последните неколку децении. Но, луѓето биле прогонувани од многу подлабок страв илјадници години. Отсекогаш сме ја ценеле моќта на приказните и сликите да манипулираат со нашите умови и да создаваат илузии. Како резултат на тоа, луѓето уште од античко време се плашат да бидат заробени во светот на илузиите

Досега, овие стравови беа фокусирани на машини кои користат средства за убивање и поробување луѓе или за замена на луѓе.

Во 17 век, Рене Декарт се плашел дека некој злобен демон може да го држи заробен во свет на илузии, создавајќи сè што гледа и слуша. Во античка Грција, Платон ја раскажал познатата „Алегорија за пештерата“, во која група луѓе се врзани со синџири во пештера, цел живот свртени кон празен ѕид. Екран. На тој екран гледаат проекција на разни сенки. Затворениците ги мешаат илузиите што ги гледаат таму со реалноста.

Во античка Индија, будистичките и хинду мудреците проповедаа(т) дека сите луѓе живеат заробени во Маите – светот на илузиите. Она што вообичаено го сметаме за реалност е често само фикција во нашите умови. Луѓето можат да водат цели војни, да убиваат други и да сакаат самите да бидат убиени, поради нивното верување во оваа или онаа илузија.

Револуцијата на вештачката интелигенција не доведува лице в лице со демонот на Декарт, со пештерата на Платон, со Маја. Ако не внимаваме, би можеле да останеме заробени зад превезот на илузијата од која не можеме да се разделиме – или дури и да разбереме дека воопшто постои.

Светлата страна на ВИ

Секако, новата моќ на вештачката интелигенција би можела да се искористи и за добри цели. Нема да се задржувам на тоа, бидејќи луѓето кои развиваат вештачка интелигенција веќе доволно зборуваат за тоа. Работа на историчарите и филозофи како мене е да укажат на опасностите.

Секако, вештачката интелигенција може да ни помогне на безброј начини, од изнаоѓање нови лекови за рак до откривање решенија за еколошката криза.

Прашањето со кое се соочуваме е како да се осигураме дека новите алатки за вештачка интелигенција се користат за добро, а не за зло. За да го направите ова, прво мора да ги процениме реалните способности на овие алатки.

Додека нуклеарките не можат да измислуваат помоќни нуклеарни оружја, вештачката интелигенција може да направи експоненцијално помоќна вештачка интелигенција. Првиот клучен чекор е да се бараат ригорозни безбедносни проверки пред моќните алатки за вештачка интелигенција да бидат пуштени во јавниот домен.

ВИ како оружје за масовно уништување на менталниот и социјалниот свет

Од 1945 година знаеме дека нуклеарната технологија може да генерира евтина енергија за човечка корист, но може и физички да ја уништи човечката цивилизација. Така, го преобликовме целиот меѓународен поредок за да го заштитиме човештвото и да обезбедиме нуклеарната технологија да се користи првенствено за добро. Сега мора да се справиме со новото оружје за масовно уништување кое може да го истреби нашиот ментален и социјален свет.

Сè уште можеме да регулираме нови алатки за вештачка интелигенција, но треба да дејствуваме брзо. Додека нуклеарките не можат да измислуваат помоќни нуклеарни оружја, вештачката интелигенција може да направи експоненцијално помоќна вештачка интелигенција. Првиот клучен чекор е да се бараат ригорозни безбедносни проверки пред моќните алатки за вештачка интелигенција да бидат пуштени во јавниот домен. Исто како што фармацевтската компанија не може да пушти нови лекови пред да ги тестира нивните краткорочни и долгорочни несакани ефекти, технолошките компании не треба да објавуваат нови алатки за вештачка интелигенција пред да ги направат безбедни. Ни треба еквивалент на Агенцијата за лекови и медицински производи.

Зарем забавувањето на јавната примена на вештачката интелигенција нема да предизвика демократиите да заостанат зад понемилосрдните авторитарни режими? Токму спротивното. Нерегулираното спроведување на вештачката интелигенција би создало социјален хаос, фаворизирајќи ги автократите и уништувајќи демократии. Демократијата е разговор, а разговорите се потпираат на јазикот. Кога вештачката интелигенција го хакира јазикот, може да ја уништи нашата способност да водиме значајни разговори, а со тоа да ја уништи демократијата.

Штотуку наидовме на нечовечка интелигенција, овде на Земјата. Не знаеме многу за тоа, освен дека може да ја уништи нашата цивилизација. Треба да престанеме со неодговорната употреба на алатките за вештачка интелигенција во јавната сфера и да ја регулираме вештачката интелигенција пред таа да не регулира нас. И првата регулатива што би ја предложил е да се направи задолжително за вештачката интелигенција да открие дека е вештачка интелигенција. Ако разговарам со некого и не можам да кажам дали е човек или вештачка интелигенција – тоа е крајот на демократијата.

* Текстот на историчарот, философ и писател Јувал Ноа Харари е преземен од порталот Лупига, а првично е објавен на Економист.